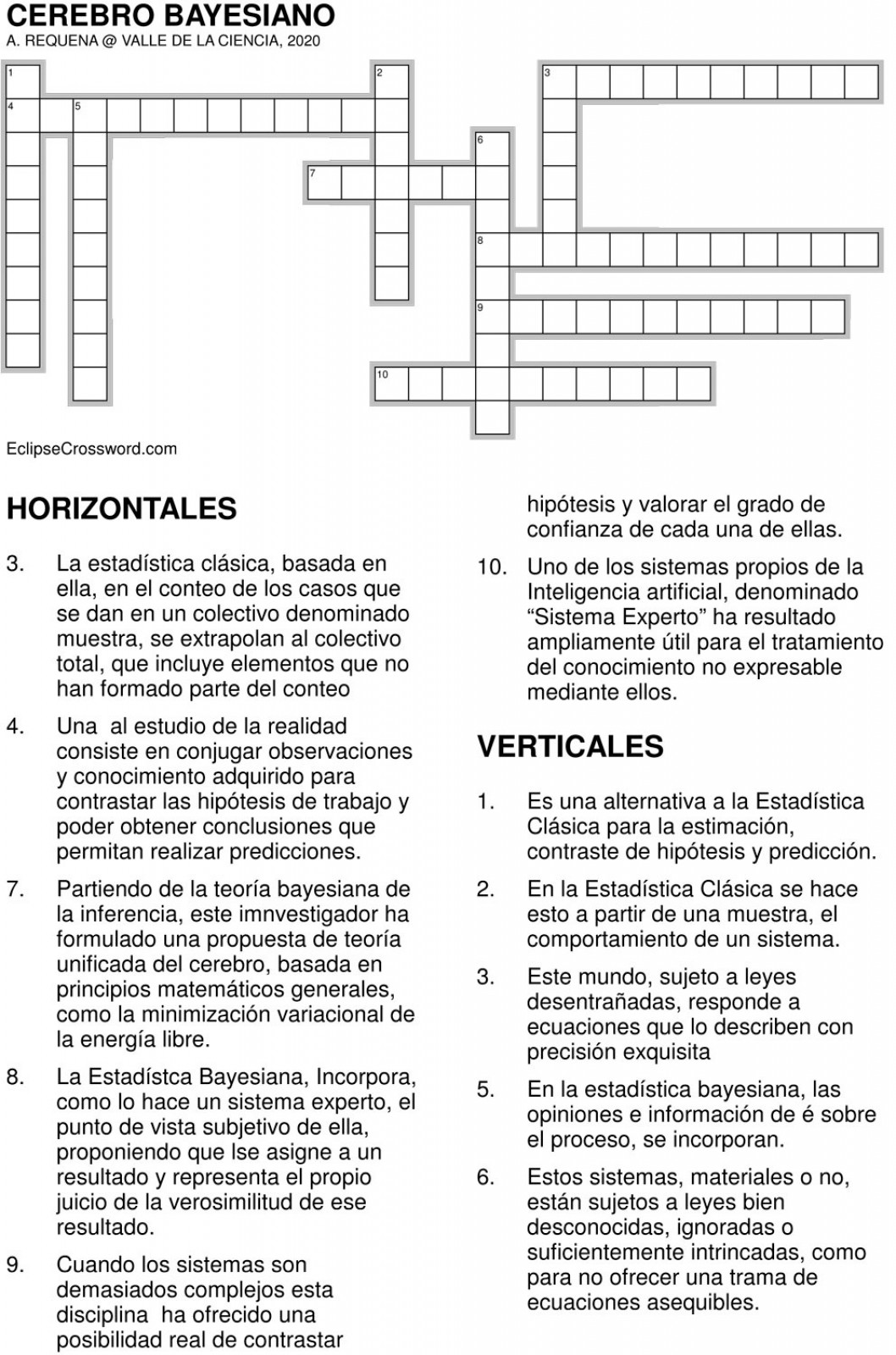

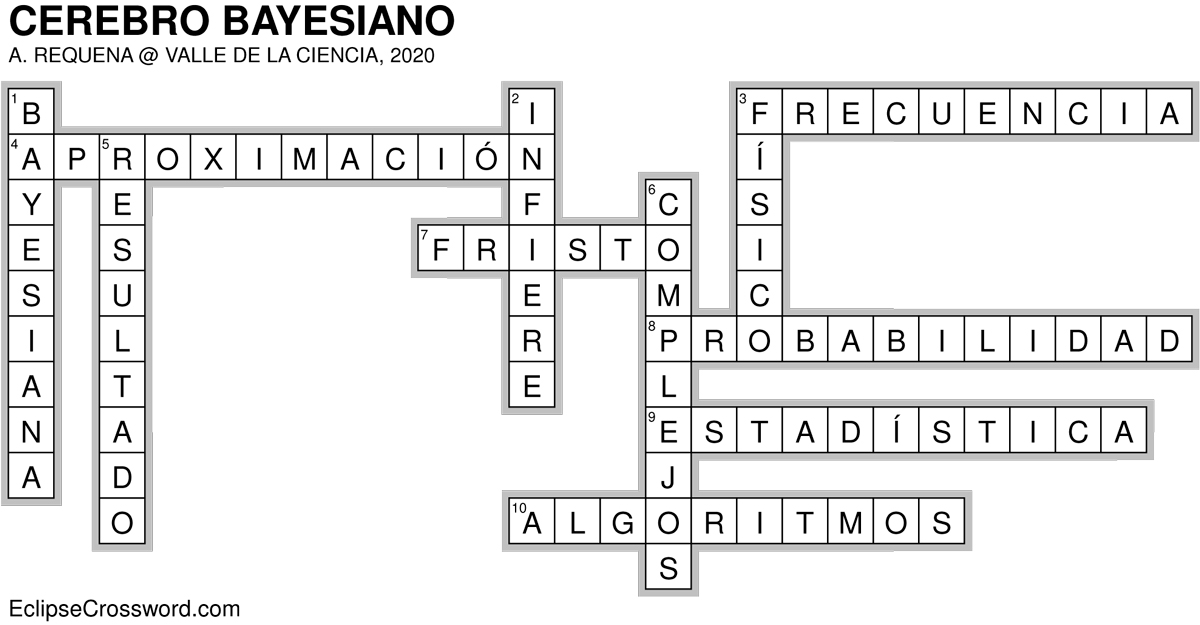

Cerebro bayesiano

Una aproximación al estudio de la realidad consiste en conjugar observaciones y conocimiento adquirido para contrastar las hipótesis de trabajo y poder obtener conclusiones que permitan realizar predicciones. El mundo físico, sujeto a leyes desentrañadas, responde a ecuaciones que lo describen con precisión exquisita. También, los sistemas complejos, materiales o no, están sujetos a leyes bien desconocidas, ignoradas o suficientemente intrincadas, como para no ofrecer una trama de ecuaciones asequibles. Todos los sistemas sociales, económicos y, en general, no materiales, están en este caso.

Uno de los sistemas propios de la Inteligencia artificial, denominado “Sistema Experto” ha resultado ampliamente útil para el tratamiento del conocimiento no expresable en algoritmos. El funcionamiento consiste en que el sistema es entrenado previamente, adquiriendo la “expertisse” de muchos expertos humanos en el ámbito de que se trate (por ejemplo, conocimiento de los que deciden la concesión de préstamos o conocimiento de los que trabajan en explotaciones petrolíferas, etc.) adquiriendo ese conocimiento que después empleará para desarrollar el trabajo que anteriormente llevaban a cabo los expertos. Es un planteamiento muy humano, porque esto es lo que hacemos, nos preparamos, aprendemos de expertos, para después poder desarrollar esas funciones, una vez adquirido el conocimiento.

Cuando los sistemas son demasiados complejos la estadística ha ofrecido una posibilidad real de contrastar hipótesis y valorar el grado de confianza de cada una de ellas. La estadística clásica, basada en la frecuencia, en el conteo de los casos que se dan en un colectivo denominado muestra, se extrapolan al colectivo total, que incluye elementos que no han formado parte del conteo. Por tanto, se infiere a partir de una muestra, el comportamiento de un sistema. Como alternativa surge la denominada estadística bayesiana para la estimación, contraste de hipótesis y predicción. La estadística bayesiana, parte del hecho de que cualquier forma de incertidumbre requiere una descripción a través de un modelo de probabilidad y que es ésta la única posibilidad de describir una lógica que maneje todos los niveles de incertidumbre y no se limite únicamente a declarar la verdad o falsedad. Incorpora, como lo hace un sistema experto, el punto de vista subjetivo de la probabilidad, proponiendo que la probabilidad que se asigna a un resultado, representa el propio juicio de la verosimilitud de ese resultado. Las opiniones e información del resultado sobre el proceso, se incorporan. Podría tener una desventaja de hacerlo indebidamente, lo que afectaría a la inferencia, aunque se puede soslayar estableciendo una distribución de probabilidad previa de referencia, muy útil cuando se tiene poca información sobre el problema. Se asigna, a priori y el teorema de Bayes permite obtener una distribución a posteriori, con la que se hacen las inferencias.

Partiendo de la teoría bayesiana de la inferencia, Friston ha formulado una propuesta de teoría unificada del cerebro, basada en principios matemáticos generales, como la minimización variacional de la energía libre, con la que pretende explicar la habilidad de sistemas complejos como el cerebro, para resistir la tendencia natural al desorden, que formula el segundo principio, y mantener un intercambio homeostático sostenido con el entorno. El principio de energía libre se ha usado para dar cuenta de una amplia gama de fenómenos sensoriales, cognitivos y motores en el escenario neuro-científico y se ha evidenciado útil para penetrar en la interioridad de la relación entre la estructura y las funciones en el cerebro.

Un problema, no menor, es la asignación de una zona del cerebro a un estímulo. Aquí es donde la inferencia bayesiana ha aportado de forma significativa. Se formula un modelo matemático sobre la actividad del cerebro, que se supone correspondería a la reacción de aquél a un estímulo. Naturalmente, para ello hay que incorporar el conocimiento previo sobre el funcionamiento del cerebro y las variables que pueden intervenir, estar implicadas, o ser extrañas al proceso. Una vez registrados los datos, se comparan con los del modelo y de su parecido se deduce la probabilidad de que una región concreta del cerebro sea la que reacciona ante el estímulo estudiado. Esta forma de proceder empleando un modelo basado en la experiencia y compararlo con datos medidos, es lo que configura la estadística bayesiana. Una de las funciones fundamentales del cerebro es realizar inferencias bayesianas, según propone Friston, entre otros Supone aceptar un modelo generativo ya que para realizar inferencias bayesianas es necesario representar, al menos de forma aproximada, una probabilidad a priori y una función de verosimilitud. Percibir es equivalente a inferir las causas de la evidencia disponible a un organismo a través de la percepción. No es una teoría del razonamiento científico, pero si lo es de como afloran las creencias a partir de observaciones, por tanto, es una teoría del aprendizaje.

Este blog pretende ser una depresión entre dos vertientes: la ciencia y la tecnología, con forma inclinada y alargada, para que por la vertiente puedan circular las aguas del conocimiento, como si se tratara de un río; o alojarse los hielos de un glaciar de descubrimiento, mientras tiene lugar la puesta a punto de su aplicación para el bienestar humano. Habrá, así, lugar para la historia de la ciencia, las curiosidades científicas y las audacias científico-tecnológicas. Todo un valle.

El eldense Alberto Requena es catedrático emérito de Química de la Universidad de Murcia.

Quizá te interese

0 Comentarios

Lo más leído del mes

Fallece una persona al caer al vacío en la Plaza del Zapatero

Elda y Petrer en riesgo naranja por lluvia, granizo y viento a partir de mañana

Un detenido en Petrer acusado de cometer una decena de agresiones sexuales a mujeres

Adiós al quinto goleador en 2ª División