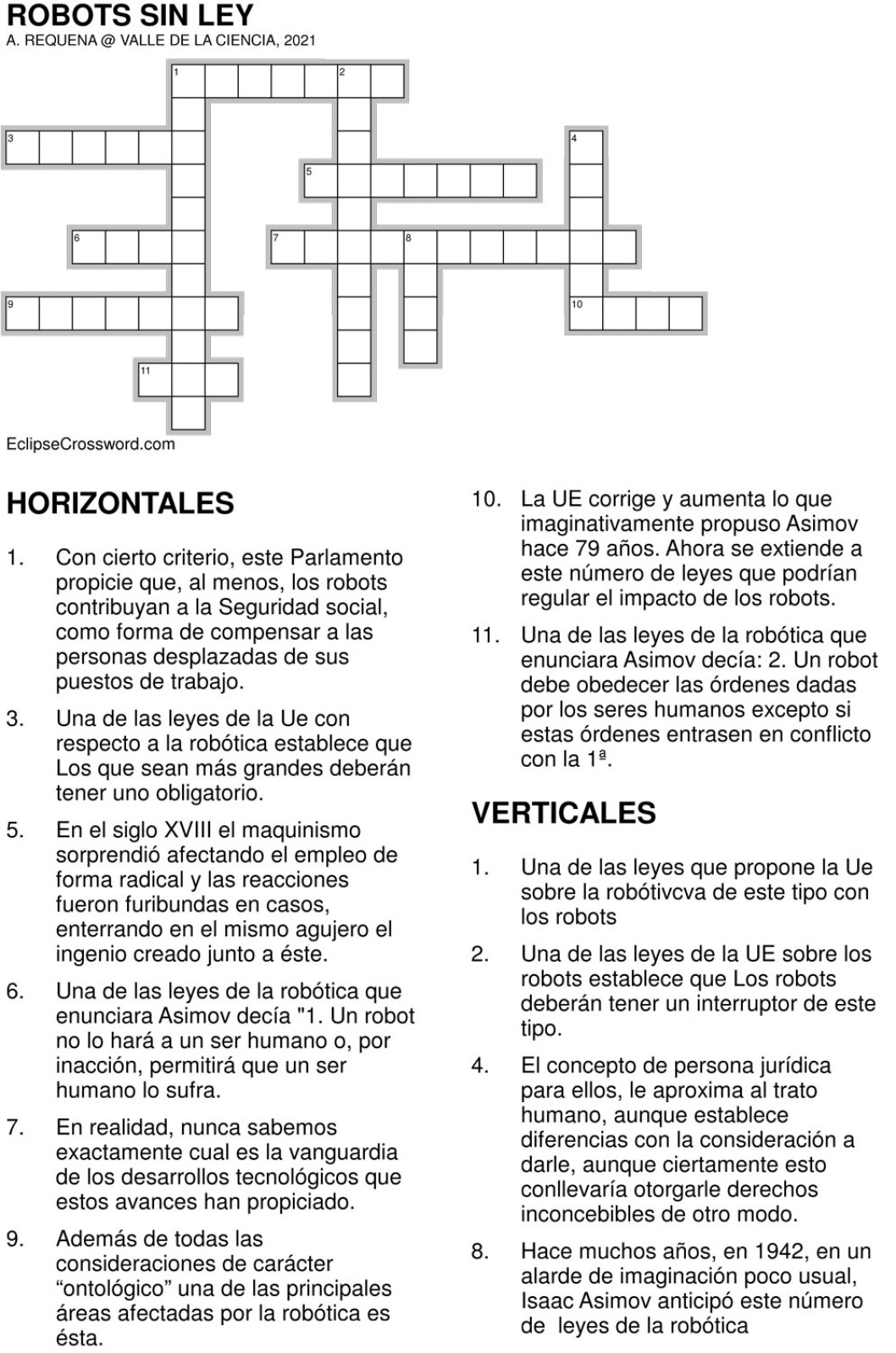

Robots sin ley

Los desarrollos tecnológicos nos sorprenden con avances más rápido de lo imaginado. Ha ocurrido muchas veces en la Historia, con desigual alcance. La sociedad no tiene un pulso sincronizado con los avances, ni siquiera conocidos. Siempre ha ido a remolque. En realidad, nunca sabemos exactamente cual es la vanguardia de los desarrollos tecnológicos que los avances científicos han propiciado. En el siglo XVIII el maquinismo sorprendió afectando el empleo de forma radical y las reacciones fueron furibundas en casos, enterrando en el mismo agujero el ingenio creado junto a su creador. Conforme la civilización ha ido avanzando, las reacciones se han dulcificado, aunque no por ello han dejado de violentar el status establecido. Ahora, la robótica está en trance de sorprendernos de nuevo, por más que se habla de ello y, en cierta medida, se trata de anticipar regulaciones, acorde con el escenario presumible.

Hace muchos años, en 1942, en un alarde de imaginación poco usual, Isaac Asimov anticipó tres leyes de la robótica, que ahora se rescatan como punto de partida en un intento de regulación de un área en gran medida desconocida, como es la robótica. Con elegancia notoria Asimov proponía

- Un robot no hará daño a un ser humano o, por inacción, permitirá que un ser humano sufra daño.

- Un robot debe obedecer las órdenes dadas por los seres humanos excepto si estas órdenes entrasen en conflicto con la 1ª ley.

- Un robot debe proteger su propia existencia en la medida en que esta protección no entre en conflicto con la 1ª o la 2ª Ley.

Ahora, en un intento de mitigar el impacto de la introducción en la sociedad de los robots, la UE corrige y aumenta lo que imaginativamente propuso Asimov hace 79 años. Ahora se extiende a seis el número de leyes que podrían regular el impacto de los robots. Independientemente de cuando se promulguen y la forma final que adopten, está claro que el fondo de la cuestión se mantiene y se vislumbra una preocupación de la sociedad que presiona a los legisladores para adoptar medidas de un mundo que se va sumergiendo en unos escenarios desconocidos, donde el alcance de las consecuencias no se es capaz de prever en estos momentos. Con la experiencia de otros hechos de similar forma, aunque alcance incomparablemente menor, ciertamente es preocupante que nos sorprenda sin la debida precaución.

La UE perfila en los seis aspectos que incluimos a continuación

- Los robots deberán tener un interruptor de emergencia

Dado que el principal mecanismo de evolución de los robots es el aprendizaje basado en el entrenamiento, dado que la infraestructura que lo sostiene, basada en redes neuronales, requiere un paso previo de aprendizaje, para establecer las conexiones de esta red neuronal, que permitirá inducir y deducir el comportamiento a ostentar al enfrentarlo a una situación conocida o desconocida. Dada la poca seguridad que ofrece el aprendizaje no supervisado, se intuye que es necesaria la precaución de un botón que se pueda accionar ante algún peligro que pudiera sobrevenir y evitar consecuencias mediante la acción de un interruptor de emergencia.

- Los robots no podrán hacer daño a los seres humanos

Desde todo punto de vista y en coherencia con la primera ley enunciada, dado que la robótica no puede concebirse sino como ayuda y cooperación con los seres humanos, no puede permitirse que pueda infringir daños a éstos. Asimov lo suponía en su primera ley y ahora se vuelve a recoger en la propuesta de la UE. Esto, naturalmente introduce una reflexión acerca del uso de robots en entornos conflictivos o bélicos, dado que infringir esta ley, implica la imposibilidad de transvase de estos entornos a los sociales usuales. Es una cuestión delicada, dado que la propia existencia de robots violentos, inquieta a la sociedad por el potencial mal uso y limitaciones que imponga esta restricción. Como veremos más adelante es un piunto de fricción fuerte, serio y de alcance.

- No podrán generarse relaciones emocionales con los robots

Este artículo se anticipa a los desarrollos previsibles, aunque ahora sea impredecible su alcance. Implica asumir que la inteligencia artificial no es capaz de desarrollar inteligencia emocional, lo que en estos momentos es una conjetura de la misma magnitud que la contraria. La parcela de los sentimientos hoy por hoy es muy humana y las máquinas no son capaces de desarrollarlos, aunque el futuro sea impredecible, Es una cautela en defensa del entorno humano y de la concepción de que las máquinas forman un mundo aparte y no caben las relaciones estrechas y personales entre ambos.

- Los que sean más grandes deberán tener un seguro obligatorio

Loa comportamientos autónomos han estado sujetos a reflexión durante un tiempo y han surgido posturas encontradas en cuanto a las capacidades operativas. La toma de decisiones conlleva la asunción de riesgos que pueden afectar a los humanos. Habrán robots de todo tipo de funciones y de distinta entidad y envergadura, pero todo parece indicar que una cautela razonable es prever los riesgos de daños materiales que en unos robots potencialmente serán más probables que en otros. Un seguro debe arrastrar con las responsabilidades de los actos, de forma similar a lo que ocurre con los humanos. Al menos tener cubierto el riesgo de daños materiales. Es probable que con el tiempo esto sea poco. Ya ha habido muertes provocadas en la conducción autónoma.

- Derechos y obligaciones para los robots

La consideración a dar derechos y obligaciones a los robots es una cuestión nada trivial. Legalmente hay que encajarlo en un ámbito que permita dotarle de los derechos y obligaciones apropiados. El debate está servido con una profundidad variable según los países. Ciertamente, la diferencia estriba en la consideración de las consecuencias, si corresponde atribuirlas a los robots o a los constructores. No es fácil decidir esta cuestión, como es de suponer. El concepto de persona jurídica, le aproxima al trato humano, aunque establece diferencias con la consideración a darle, aunque ciertamente esto conllevaría otorgarle derechos inconcebibles de otro modo.

- Tendrán la obligación de pagar impuestos

Además de todas las consideraciones de carácter “ontológico” una de las principales áreas afectadas por la robótica es la laboral. La cuestión de la sustitución de los humanos por máquinas es una cuestión pendiente de la Humanidad desde el comienzo del maquinismo. Para los dueños de los medios de producción la cosa parce clara, sustituyen con beneficio para el resultado dado que la capacidad de trabajo es mayor, la perfección en la labor se incrementa, el coste se amortiza y se obvian muchos costes asociados a aspectos sociales. Para los trabajadores no está nada claro, al verse amortizado antes de lo usual, sin una compensación apropiada al cese de actividad obligado al que se ve abocado. Así que en los comienzos las reacciones eran muy violentas, hasta el punto de que las novedades se veían atacadas hasta su destrucción, junto a la de los que la habían concebido. Contemplamos hoy, como las cosas han cambiado bien poco. Es por ello que, con cierto criterio, el Parlamento Europeo propicie que, al menos, los robots contribuyan a la Seguridad social, como forma de compensar a las personas desplazadas de sus puestos de trabajo. Aquí asistiremos a un amplio enfrentamiento entre los dueños de los medios de producción y los que la trabajan.

Son estos unos puntos de litigio que deben abordarse con serena sensatez y neutralidad, procurando armonizar intereses encontrados. No conseguimos nada, obviando el debate y dejándolo para cuando surja, porque, como vamos viendo con los acontecimientos que vivimos, a diario se sobrepasan los límites legales en todas aquellas esferas en las que la lesgilación va por detrás de los adelantos, que es en casi todas las áreas.

Esta misma semana se ha presentado una enmienda a la totalidad, que dirían los legalistas, cuando Rusia se ha opuesto a que se regulen sus robots “asesinos”, referidos a los que son capaces de disparar y destinados a conflictos bélicos. No son los únicos que se oponen. De hecho Libia ha usado drones de combate contra soldados humanos en retirada. Arguyen que son robots tan buenos que no necesitan leyes creadas a la medida. La autonomía con la que funcionan responde a algoritmos sofisticados capaces de distinguir entre enemigos y aliados y no necesitan controles específicos de tal cosa. El tema se debate en la ONU y, aparentemente, no ha encontrado eco en otros países, pero quién sabe en que desembocará. Cruz Roja advierte la perplejidad de que un algoritmo decida quién debe morir o vivir.

Estamos en el albor, no de la tecnología, sino de la reflexión sobre su uso. Ninguna situación histórica anterior es similar. Ni siquiera la aparición de la energía nuclear en su día, aunque se utilizara en sus primeros compases para la destrucción humana. La diseminación actual de la tecnología y las facilidades de su construcción y acceso, articulan una pandemia tecnológica garantizada, donde los usos son incontrolables. Unos las fabrican y las tienen que vender, otros quieren usarlas y las compran.

Ciertamente estamos en un dilema histórico en el que participamos, la mayor aparte de las veces de meros espectadores, aunque seamos los sufridores, al fin de las jugadas y no necesariamente el futuro es más amable que el tiempo vivdo hasta el presente. Todos estamos obligados a adaptarnos al entorno, pero debemos cuidar derechos, deberes, obligaciones y controles que permitan hacer la vida más cómoda e llevadera. De no ser así, no es progreso y en ese caso, deberíamos denostarlo.

Este blog pretende ser una depresión entre dos vertientes: la ciencia y la tecnología, con forma inclinada y alargada, para que por la vertiente puedan circular las aguas del conocimiento, como si se tratara de un río; o alojarse los hielos de un glaciar de descubrimiento, mientras tiene lugar la puesta a punto de su aplicación para el bienestar humano. Habrá, así, lugar para la historia de la ciencia, las curiosidades científicas y las audacias científico-tecnológicas. Todo un valle.

El eldense Alberto Requena es catedrático emérito de Química de la Universidad de Murcia.

Quizá te interese

0 Comentarios

Lo más leído del mes

Elda suspende el concierto de Henry Méndez por sus "discursos de odio"

Estafa en Elda: un hombre se aprovecha de una mujer con discapacidad y le roba más de 11.000 euros

"Elda lo ha significado todo para mí"

Denuncian carreras de patinetes en Petrer tras el atropello de un niño en la plaza Unión de Festejos